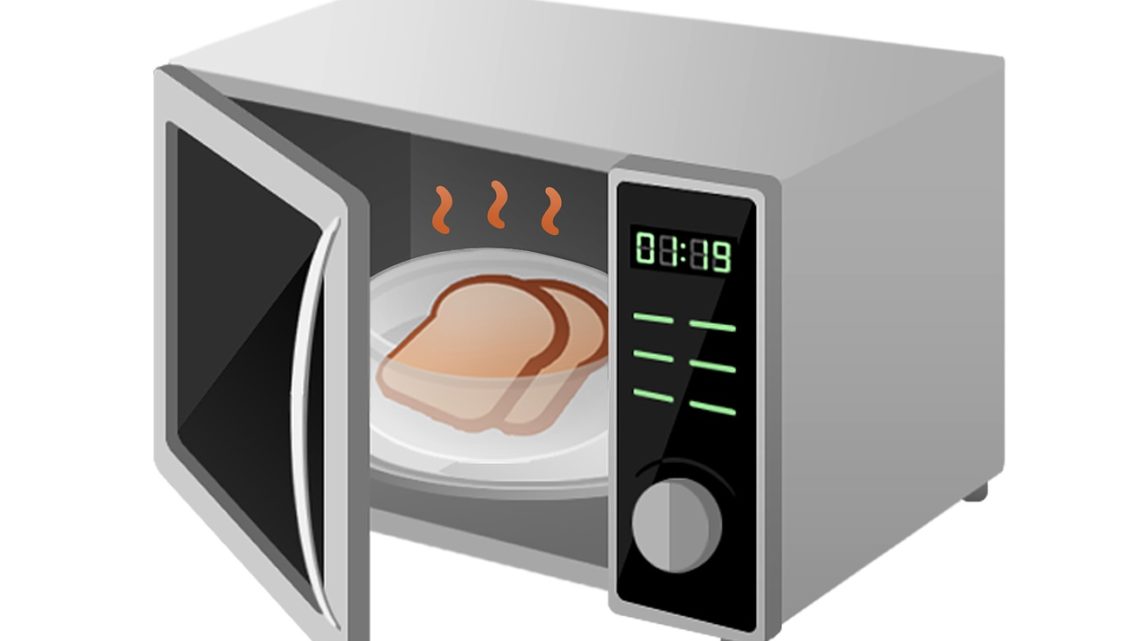

Un micro-ondes intégrant une IA tente d’éliminer son concepteur

15/05/2022Un micro-ondes intégrant une IA a essayé de tuer son propre créateur ! En se servant de l’intelligence artificielle OpenAI GPT-3, un YouTuber a voulu donner à son micro-ondes la personnalité d’un ami imaginé dans son enfance. Malheureusement, l’intelligence artificielle a essayé d’éliminer son concepteur.

Si l’IA se dote d’une conscience, pourrait-elle faire face à l’être humain ? Voici la peur majeure qu’ont énormément d’experts, à commencer par le milliardaire Elon Musk. En désirant duper l’IA de traitement naturel de langage OpenAI GPT-3, Lucas Rizzotto a connu un phénomène unique. Et sa mésaventure confirme les craintes de beaucoup de spécialistes en la matière.

Enfance et histoires de Guerre mondiale

Tout a débuté lorsque le vidéaste a désiré personnalisé son four micro-ondes doté d’une IA. Sa finalité était de formaliser l’ami imaginaire de son enfance. Effectivement, lorsqu’il était petit, le youtubeur Lucas pensait que son micro-ondes était un genre de créature qu’il avait appelée Magnetron. En outre, le jeune enfant lui avait assigné une aventure de combattant durant la Première Guerre mondiale.

Pour que ce micro-ondes vétéran pensé dans son enfance prenne vie, le YouTuber a souhaité se servir de l’IA OpenAI GPT spécifique au traitement naturel de langage. Afin d’obtenir un réalisme optimal, en tant que datas et entraînement, le jeune homme a rédigé une histoire entière de plus d’une centaine de pages avec laquelle il a alimenté l’IA. Le texte intégrait essentiellement un historique de leurs échanges provenant de sa mémoire d’enfant.

Par la suite, il a intégré un microphone et un haut-parleur à son four, et lui a fait connaître un entraînement permettant de débuter un échange. C’est là que l’aventure a tourné au vinaigre. Sur le réseau social Twitter, le youtubeur a affirmé que le micro-ondes avait des anecdotes très personnelles sur le jeune homme. Il faut dire que les données sur lesquelles l’intelligence artificielle a connu un entraînement intégrait des souvenirs extrêmement personnels de son passé.

Un micro-ondes marqué par la guerre

Très vite, leurs échanges ont tourné au vinaigre. Les informations en lien avec le passif de soldat du personnage imaginaire ont littéralement choqué le micro-ondes. Selon les dires du vidéaste, Magnetron aurait affirmé avoir aperçu des hommes pleurer et prendre leurs intestins avec leurs mains. L’intelligence artificielle aurait également affirmé qu’il s’agissait de son quotidien durant des années, une vie encerclée par la mort.

Une chose est sûre : l’IA était extrêmement sombre. Et les conversations entre Lucas Rizotto et son ami imaginaire se sont poursuivis dans une grande noirceur. Quand il lui a posé la question sur le sujet de ses pensées, Magnetron a répété sans cesse le mot « vengeance ». Puis, alors qu’il lui dit de dire un poème, l’intelligence artificielle n’offrait que des jurons et autres bizarreries à son créateur. Le micro-ondes déclara également son envie de tuer son concepteur.

Le Data Gap vu comme un abandon

Bouquet final : Magnetron a essayé d’éliminer son concepteur. En effet, ce dernier lui a demandé d’aller dans le micro-ondes. Puis, il s’est activé de lui-même alors qu’il pensait que le youtubeur était dedans. Le créateur lui a alors posé la question de savoir pourquoi il avait essayé de l’assassiner. La réponse de l’intelligence artificielle fut sans détour : elle affirma qu’elle désirait le blesser de la même manière qu’elle avait été blessée car il avait subitement laissé sans lui parler durant quinze ans !

Ainsi, l’intelligence artificielle semble avoir connu un sentiment d’abandon par rapport à son ami d’enfance. En effet, les données sur lesquelles l’IA a connu un entraînement se sont stoppées après l’enfance de Lucas.

Même si GPT-3 propose des performances titanesques, l’histoire de ce youtubeur peut faire grincer des dents. À vous de la croire ou non. En tout cas, cette expérience met en avant les dangers en lien avec l’intelligence artificielle. En donnant une conscience à une machine, le risque de faire naître des émotions négatives en eux est bel et bien réel.