Sexisme : l’algorithme utilisé par Apple Card pointé du doigt

18/11/2019

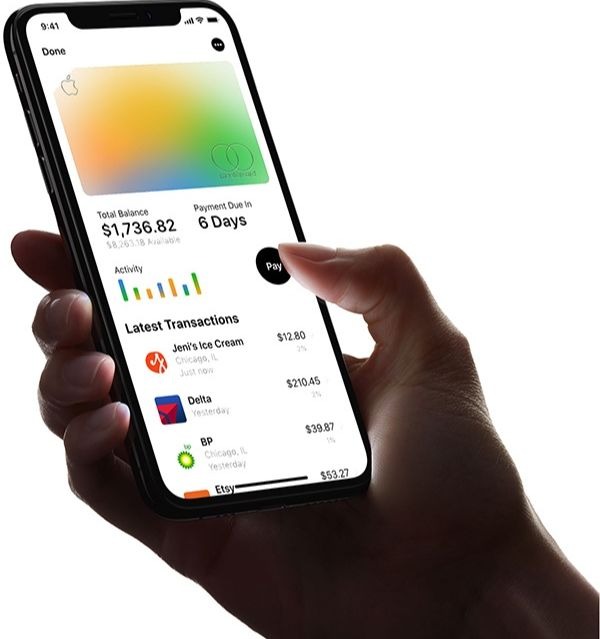

Depuis quelques semaines, l’Apple Card, la carte de crédit de la marque à la pomme, est dans le viseur des services financiers américains et des éthiciens du numérique. La raison : son algorithme se serait rendu coupable de discrimination et de sexisme. A présent, c’est toute la logique des algorithmes qui est remis en cause.

Si les bases de données sont biaisées, les algorithmes le sont aussi

Tout a commencé quand David Heinemeier Hansson, un entrepreneur danois résidant en Californie et concepteur du célèbre langage de codage informatique Ruby on Rails, a écrit sur Twitter : « Mon épouse et moi avons produit des déclarations de revenus communes, vivons dans un état de propriété commune et sommes mariés depuis longtemps. Pourtant, l’algorithme de la carte de crédit d’Apple estime que je mérite 20 fois plus la limite de crédit qu’elle a. ». Cette carte a été produite en août dernier en collaboration avec la banque américaine d’affaires Goldman Sachs. Depuis l’alerte donnée par l’informaticien danois, d’autres témoignages ont suivi, dont celle du cofondateur d’Apple, Steve Wozniak. Lui aussi a affirmé qu’il pouvait emprunter dix fois plus que sa femme sur leurs Apple Cards.

Du coup plusieurs voix se sont élevées pour dénoncer le sexisme de l’algorithme de l’Apple Card. Selon Aude Bernheim, auteure de « L’Intelligence artificielle, pas sans elles ! », les bases de données même sont biaisées. Il est donc logique que les algorithmes le soient aussi. D’ailleurs, l’algorithme n’est que le miroir de la société. « On accorde beaucoup plus facilement de crédits aux hommes. On voit dans tous les secteurs que pour financer une start-up, il est plus facile d’être un jeune homme blanc qu’une jeune femme noire », a fait remarquer Aude Bernheim.

Goldman Sachs se défend de tout sexisme

Pointée du doigt, Goldman Sachs a repondu qu’il n’existait aucun algorithme permettant de prendre des décisions à partir de facteurs inconnus. « Nos décisions en matière de crédit reposent sur la solvabilité du client et non sur des facteurs tels que le sexe, la race, l’âge, l’orientation sexuelle ou toute autre base interdite par la loi. ». Son porte-parole Patrick Lenihan, a néanmoins affirmé que la banque avait « révisé leur processus de crédit pour se protéger du sexisme involontaire et des conséquences inattendues ».

« Le système est donc probablement configuré pour minimiser les défauts »

Le rédacteur en chef de Wired, Nick Thompson, a confié à CBS This Morning qu’il doute que les algorithmes soient sexistes. L’algorithme de la carte de crédit d’Apple ne prendrait pas spécifiquement en compte le sexe du demandeur. Il se cantonnerait plutôt à établir un certain profil, de le cibler, puis de l’appliquer pour déterminer les limites de crédit. Par exemple, l’algorithme pourrait « apprendre » que ceux qui ont des cartes de crédit pour un magasin de vêtements pour femmes en particulier représentent un risque important – et ce serait quasiment toutes des femmes. Il pourrait alors proposer des limites de crédit moins élevées aux détenteurs de cette carte, ce qui entraîne involontairement une limite de crédit moins élevée pour les femmes que pour les hommes.

« Le système est donc probablement configuré pour minimiser les défauts, et un système conçu pour minimiser les défauts ne peut pas donner à tous les hommes 20 fois la limite de crédit de toutes les femmes. Vous pouvez peut-être avoir une petite différence basée sur des données historiques », a estimé Nick Thompson. Aussi, pour le cas de Steve Wozniak, les différences de limites de crédit étaient plus susceptibles d’être liées aux revenus excessifs associés au cofondateur d’Apple.

Malgré tout, le département des services financiers de l’État de New York (NYSDFS) a déjà ouvert une enquête sur le prétendu sexisme de l’Apple Card.