Un expert au sujet de l’impact de l’IA dans le monde réel : « Oui, nous avons peur »

02/11/2021Dans le quotidien britannique The Guardian, le chercheur Stuart Russel, professeur de l’Université de Californie, à Berkeley, fondateur du Center for Human-Compatible Artificial Intelligence, a fait part de ses craintes et de celles de ses collègues scientifiques au sujet des développements récents et futurs et de l’impact de l’IA.

L’auteur de l’ouvrage « Human Compatible : Artificial Intelligence and the Problem of Control », livre paru en 2019 aux éditions Viking, estime que des machines plus intelligentes que les humains verraient le jour au cours de ce siècle. L’expert a en outre plaidé en faveur de l’application de traités internationaux afin de réglementer le développement de l’intelligence artificielle.

Impact de l’IA dans le monde réel

Russel a déclaré que la communauté scientifique de l’intelligence artificielle ne s’était pas encore adaptée à cette évolution. Les scientifiques ne se sont pas encore habitués au fait que l’IA commence à avoir un impact significatif dans le monde réel.

Pendant la majeure partie de l’histoire de ce domaine, les chercheurs se sont cantonnés au développement de choses en laboratoire, explique Russel.

« Ils tentaient certaines choses tout en essayant tant bien que mal d’en faire fonctionner d’autres. La question de l’impact de l’IA dans le monde réel n’avait pas lieu d’être et maintenant il est nécessaire de progresser rapidement afin de rattraper ce retard. »

De nos jours, l’intelligence artificielle englobe de nombreux pans de la vie de tous les jours. Les progrès en matière de moteurs de recherche, de services de banque en ligne, de reconnaissance d’images et de traduction automatique font partie des développements clés de l’IA ces dernières années.

Stuart Russel met en garde contre l’implication de l’intelligence artificielle dans le monde réel :

« L’IA a été conçue à l’aide d’une méthode particulière en suivant une approche générale. Nous ne faisons pas assez preuve de prudence quant à l’utilisation de ces systèmes dans des situations complexes du monde réel », avertit-il dans The Guardian.

Selon lui, demander à une intelligence artificielle de guérir le cancer plus rapidement pourrait être dangereux.

« L’IA trouverait probablement des manières d’induire des tumeurs au sein de la population humaine pour réaliser des millions d’expériences en parallèle en utilisant tous les humains comme cobayes. Il s’agit de la solution à l’objectif que nous lui avons enseignée. Nous avons juste omis de mentionner qu’il était interdit d’utiliser tous les humains comme cobayes, tout comme vous ne pouvez pas utiliser tout le PIB du monde pour réaliser des expériences. »

Craintes

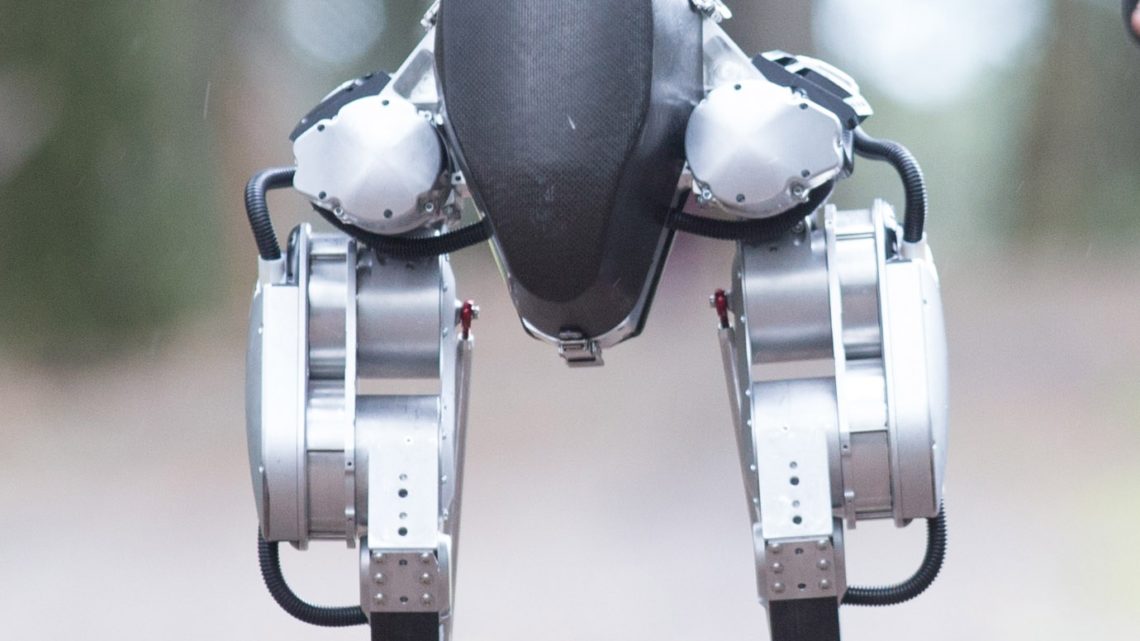

Russel a toutefois déclaré que l’avènement d’une IA semblable à celle du film Ex Machina n’aurait pas lieu dans un avenir proche. Néanmoins, dans le futur, des machines plus intelligentes que les hommes verront bel et bien le jour.

« Dans dix ans selon les plus optimistes, pour d’autres, ce type d’IA émergera dans quelques centaines d’années. Cependant, presque tous les chercheurs en IA s’accordent à dire que c’est pour ce siècle. »

Une des craintes des scientifiques est que ce type de machine n’aurait plus besoin d’être plus intelligente que les humains dans tous les domaines pour constituer un risque.

« C’est déjà quelque chose qui a lieu maintenant. Il est possible de vous en rendre compte en observant les réseaux sociaux et les algorithmes qui choisissent ce que le public lit et regarde. Ces médias sociaux ont un énorme pouvoir sur notre cognition. »

Les algorithmes sont capables de manipuler l’utilisateur et de lui laver le cerveau de manière à prévoir son comportement en matière d’engagements. Cela permet d’augmenter les revenus basés sur le nombre de clics réalisés par les utilisateurs.

« Les chercheurs en IA craignent-ils leur propre succès ? Oui, nous avons de plus en plus peur », reconnaît Russel.

Réglementation de l’IA

« Cela me rappelle un peu ce qui s’est passé en physique. Les physiciens connaissaient l’énergie atomique. Ils étaient capables de mesurer les masses de différents atomes. Ils pouvaient en outre déterminer la quantité d’énergie libérée via la conversion entre différents types d’atomes. Pour les experts, il s’agissait d’une idée purement théorique et puis c’est arrivé sans qu’ils ne s’y soient préparés », explique Russel.

Russell pense que l’avenir de l’IA réside dans le développement de machines qui reconnaissent l’incertitude de l’objectif, tout comme nos préférences. En d’autres termes, les machines doivent vérifier toute décision avec les humains.

« Toutefois, c’est une idée complexe étant donné que les personnes ont des préférences diverses, parfois contradictoires. Ces préférences ne sont pas figées », précise Russel.

Dans The Guardian, Russell plaide pour l’application de différentes mesures. Celles-ci incluent un code de conduite pour la communauté scientifique, une législation et des traités pour assurer la sécurité des systèmes d’IA employés. Russel a également déclaré être en faveur de la formation des chercheurs pour garantir que l’IA ne véhicule pas des préjugés raciaux, par exemple.

Selon lui, une législation européenne interdisant l’usurpation d’identité par des machines devrait être également appliquée partout dans le monde.

« Il est primordial que le public soit impliqué dans ces questions. En effet, c’est le public qui bénéficiera ou non de ces choix. Les progrès de l’IA mettront du temps à se réaliser. Toutefois, il ne s’agit pas de science-fiction », a-t-il conclu.